Правильный выбор процессора под видеокарту – как избежать проблем

Процессор (CPU) и видеокарта (GPU) – одни из самых важных компонентов компьютера, но чтобы использовать весь их потенциал, нужно грамотно их сочетать.

Как гласит известная поговорка, две головы лучше, чем одна, поэтому мы идём на помощь и пытаемся ответить на вопрос: как выбрать процессор для GPU?

Почему правильный выбор CPU для GPU так важен

CPU, или центральный процессор (ЦП), часто называют сердцем и мозгом компьютера (и не только компьютера). Он играет важную роль, поскольку без него устройство не могло бы функционировать. Он анализирует и обрабатывает информацию, а также производит вычисления. Например, в играх он отвечает за определение положения персонажей и элементов окружения или подсчитывает каждое движение врагов и транспортных средств.

Правильное соответствие центрального процессора видеокарте (GPU) имеет решающее значение, поскольку эти компоненты оказывают наибольшее влияние на производительность нашего компьютера.

Неправильный выбор процессора не позволит видеокарте расправить крылья, а значит – в играх не удастся добиться достаточно высокого количества кадров (FPS). Это, в свою очередь, существенно сказывается на комфорте игры.

Если ЦП слишком медленно отправляет инструкции видеокарте, другой компонент, отвечающий за отображение изображения, которое вы видите на экране, должен ждать следующего полезного набора данных, просто скучая, как мопс. Это цель, которую точно никто не должен преследовать.

Вопреки видимому, подбор этих компонентов может быть сложнее, чем кажется. Производители процессоров одаривают потенциальных потребителей многочисленными моделями, чтобы им было из чего выбрать. Поэтому в этом руководстве мы объясним, на что обратить внимание, чтобы с умом выбрать процессор для вашей видеокарты.

Если ваша жажда знаний не была удовлетворена, дополнительную информацию о процессорах и видеокартах можно найти в наших руководствах по выбору процессора и видеокарты. Они облегчат сопоставление этих компонентов. Кроме того, они являются хорошей отправной точкой для этого руководства.

Узкое место компьютера – что это такое и как избежать

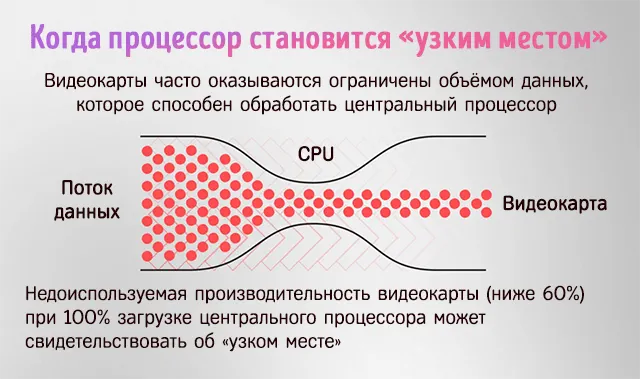

Узкое место возникает, когда один из компонентов ограничивает другой. Представьте, что у вас есть быстрая машина, но из-за встроенной системы ограничения скорости до относительно низких значений вы не сможете ощутить её мощь. Другими словами – она не будет разгоняться так, как могла бы разогнаться на хорошей трассе.

То же самое касается комбинации процессора и видеокарты, при которой один чип может тормозить другой. Когда вы сопоставляете слишком слабый процессор с мощным графическим процессором, вы не узнаете истинный потенциал последнего, так как он будет ограничиваться возможностями первого. Таким образом, процессор станет упомянутым ограничителем скорости.

Что ждёт видеокарту в такой компании? Пока вы не замените процессор на более производительный, она будет работать в пол силы, и игрок не увидит высокого FPS в играх.

Что делать, чтобы избежать этой ситуации? Достаточно ли простого совета: «Не покупайте процессор за 5000 рублей вместе видеокартой стоимостью 100 000 рублей»? Такое сочетание не имеет большого смысла даже в сознании крестьянина, но тема требует более широкого развития.

Явление узкого места относится не только к процессору и видеокарте, поскольку проблема может быть, например, в оперативной памяти, которая также тесно связано с играми.

Как может проявиться узкое место со стороны процессора? Вы можете столкнуться с резким падением плавности анимации во время игр, особенно в местах, зависящих от процессора.

Вы уже знаете, что возникновение феномена узкого места со стороны процессора в одной игре не обязательно приводит к такому же эффекту в другой. Что мы можем сделать с этим знанием? Как свести к минимуму эффект узкого места?

Перейдём к самой важной части, которая более широко ответит на надоевший вопрос: как избежать узких мест?

На что обратить внимание при выборе процессора и видеокарты

Прежде чем выбрать правильный процессор для вашей или планируемой видеокарты, обязательно учтите несколько факторов. Они решат, какой процессор лучше всего подходит для вашего компьютера, чтобы он не замедлял заметно, а лучше вообще не замедлял производительность графического процессора.

Важные факторы при выборе процессора под видеокарту

В первую очередь, стоит задать себе несколько вопросов:

- Для чего используется ваш компьютер?

- Если играете, то в какие игры и какого жанра?

- В каком разрешении вы предпочитаете играть?

- Какая частота обновления (в Гц) у вашего монитора и к какому уровню FPS вы стремитесь?

Игровой компьютер или нет – какой процессор выбрать для игр

Это первый вопрос, на который вам нужно ответить. Ведь подбор компонентов не обязательно должен быть универсальным. Всё зависит от того, для чего будет использоваться компьютер. Однако вы можете настроить компоненты так, чтобы они хорошо работали как в (новых) играх, так и, например, при потоковой трансляции или монтаже фильмов.

В настоящее время для игр достаточно 6-ядерного (и желательно 12-поточного) процессора, но тот факт, что консоли PS5 и Xbox Series X/S имеют 8-ядерный и 16-поточный процессор, может привести к более эффективному использованию большего количества ядер.

Имейте в виду, что процессор не равен процессору. Изменения и усовершенствования в архитектуре оказывают большое влияние на производительность и на то, будет ли соединение с конкретной видеокартой – более или менее – успешным.

Подтверждением этих слов станет процессор AMD Ryzen 5 1600X (Zen) 2017 года, который имеет такое же количество ядер и потоков, как и выпущенный в 2020 году Ryzen 5 5600X (Zen 3). Процессор первого поколения может «душить» более новые и производительные видеокарты, потому что его мощность явно отличается от современного процессора.

В играх важнее физические ядра, поэтому 6-ядерный и 6-поточный процессор будет лучше, чем 4-ядерный и 8-поточный. Даже современные 4-ядерные и 8-поточные блоки будут ограничивать мощную видеокарту (модели серий RTX 3000 и RX 6000 и новее).

Если вы играете, ответьте на вопрос: стримите ли вы во время игры? Да!? Тогда инвестиции в мощный процессор с несколькими ядрами имеют еще больше смысла.

Комбинация CPU и GPU для офисного и (полу)профессионального использования

Что делать, если компьютер не предназначен для игр? Для офисного компьютера процессор важнее видеокарты. В этом случае последний компонент обычно представляет собой интегрированный чип, даже несмотря на то, что операционная система Windows всё больше и активнее использует графический процессор. Если в процессоре нет встроенной видеокарты, можно выбрать самую дешевую модель из семейства GeForce или Radeon для простых офисных задач.

Процессор для простых офисных задач, работы в Интернете или воспроизведения фильмов не обязательно должен быть мощным. Достаточно дешёвой модели вроде Intel Celeron, Pentium, Core i3 или AMD Athlon или Ryzen 3 (в случае «красных» желательно APU со встроенной графикой).

Процессор помощнее (например, Intel Core i5 или AMD Ryzen 5) может пригодиться для чуть более требовательного к железу софта или, например, использования многих приложений, но вам не нужна топовая модель с разблокированным множителем (например, серия K от Intel) и флагманский GPU за несколько 100 тысяч рублей.

Для (полу)профессионального использования, такого как рендеринг, графика, редактирование фильмов, предпочтителен ЦП с большим количеством ядер и потоков – он становится ещё более важным, как и видеокарта, но это зависит от того, что вы делаете. Для самых ресурсоемких задач, таких как CAD/CAM, вы можете выбрать процессор, предназначенный для профессиональной среды, такой как AMD Threadripper, который можно комбинировать с графическим чипом RTX Quadro или Radeon Pro.

В какие игры (жанры) вы играете

Что, если процессор и видеокарта предназначены для игр? Вы играете в новые или старые игры? Какие жанры игр вы предпочитаете? Это стратегии, инди-проекты, приключенческие игры или, может быть, современные ролевые игры, шутеры или игры, ориентированные на сотрудничество и онлайн-геймплей?

Требования к компонентам зависят от игры и жанра, поэтому подумайте, во что вы играете и во что собираетесь играть. В конце концов, может случиться так, что ваш нынешний компьютер – ограниченный процессором или видеокартой – мешает вам запускать в новую игру, и вы не хотите ограничивать себя «старыми вещами» в будущем. Необходимо обязательно учитывать эти факторы.

Например, для изометрических RPG, напоминающих классику жанра, не нужны (как правило) такие мощные CPU и GPU, как для игровых продуктов ААА-класса. Тогда зачем инвестировать в Core i9 или Ryzen 9? Другое дело, когда вы хотите играть с максимально возможным FPS и высокими настройками графики, включая трассировку лучей, тогда выбор топовых компонентов имеет наибольший смысл.

Процессор больше не актуален в играх?

Правда в том, что современные игры всё больше используют мощность видеокарты, а центральный процессор часто отходит на второй план. Исключениями являются, например, стратегии вроде серий Total War и Civilization или киберспортивные игры, такие как CS:GO (Counter-Strike: Global Offensive) и LoL (League of Legends), которые очень сильно используют мощь одного ядра.

В свою очередь, многопользовательские игры с большим количеством персонажей на экране являются средоточием многоядерности – и мощности процессора в целом, поэтому серия Battlefield станет прекрасным примером. В свою очередь, для Rainbow Six: Siege не достаточно даже новейшего 6-ядерного процессора. Для игры Ubisoft также стоит инвестировать в более эффективную видеокарту.

Это не означает, что ЦП перестает иметь значение, потому что это не так. Многие игры, в том числе с открытым миром, по-прежнему требуют достаточно быстрого CPU, который будет хорошо работать с видеокартой, обеспечивая достаточно высокую производительность. Новые игры также начинают постепенно использовать больше ядер и лучше использовать потоки, поэтому их слишком малое количество может привести к эффекту узкого места.

Только учтите, что производительность процессора зависит не только от мощности и количества ядер (потоков), но и от тактовой частоты, объёма кэш-памяти и оперативной памяти. Подключение к видеокарте очень важно, потому что GPU будет настолько быстрым, насколько это позволит CPU.

Имеет ли значение разрешение при выборе процессора

Да, и очень большое. Чем выше разрешение, тем важнее становится процессор. Вы можете позволить себе выбрать чуть более слабый процессор для более мощного графического процессора. Но даже при разрешениях 1440p (2560 x 1440 пикселей) и 4K (3840 x 2160 пикселей) процессор по-прежнему очень важен.

Между этими компонентами не должно быть слишком большого разрыва!

При разрешении 1080p (или ниже) процессор выходит вперёд – руководствуйтесь здравым смыслом. Тогда видеокарта не обязательно должна быть с верхней полки, ведь вы все равно не будете использовать её полную мощность. Она покажет весь свой потенциал только в более высоких разрешениях. Если вы играете в Full HD, лучше выбрать чуть более слабую видеокарту, а не комбинировать дешёвый неэффективный CPU с очень мощным GPU, предназначенным для высоких разрешений.

В Full HD для полного использования потенциала самых мощных видеокарт – иногда даже в разрешении 1440p – может не хватить даже Intel Core i9 и AMD Ryzen 9, флагманских CPU. Тогда стоит попробовать разогнать процессор и/или оперативную память, либо купить более быструю память (к тому, насколько они важны по отношению к процессору, мы ещё вернемся).

Если у вас монитор с высокой частотой обновления (например, 144, 240 или более Гц) и вы предпочитаете производительность разрешению, то также подумайте о более мощном процессоре. Тот, который сможет соответствовать скорости видеокарты. Ведь она тоже должна быть качественной, иначе вы не получите достаточно высокого количества FPS.

Только эти два хорошо связанных компонента (три, если мы включим ещё и оперативную память) приведут к высокой плавности анимации и использованию возможностей высокочастотного монитора.

Для киберспортивных игр вам не нужны самые мощные устройства, но если вы хотите насладиться очень высокой частотой кадров и высочайшей детализацией в разрешении 1080p в самых требовательных играх, выберите топовые модели как процессора, так и видеокарты.

Как обстоят дела в высоких разрешениях? Разница между, например, Ryzen 5 2600X (Zen второго поколения) и Ryzen 5 5600X (Zen четвертого поколения) может быть размыта. В большей степени это относится к 4K (значительное улучшение ощущается на 1440p), где выбор более мощного процессора может быть неоправданным.

Эту ветку можно резюмировать кратко: более медленный процессор лучше работает в 4K, чем в Full HD.

В контексте процессора важно только разрешение?

Важно не только разрешение, но и множество графических настроек. Чем выше детализация, которую вы установите, тем меньшую роль будет играть ЦП. Так как у GPU будет больше работы. Если только мы не говорим о сильно зависящих от мощности процессора, например, геометрия, LoD (уровень детализации), количество объектов, теней и частиц, дальность прорисовки, поле зрения (FOV), плотность скопления людей, растительность и дальность её видимости или параметры, связанные с физикой. Их снижение может свести к минимуму эффект узкого места процессора.

Если вам нужно играть во все Ultra, направьте свой бюджет больше на GPU, чем на CPU. Когда видеокарта уже не справляется, то можно понизить настройки графики, которые больше всего используют этот компонент, чтобы увеличить количество кадров в секунду. К таким вариантам относятся, в том числе сглаживание, качество теней, детализация текстур, окружающее затенение, освещение, отражения или эффекты постобработки. Кроме того, вы можете уменьшить разрешение.

Играет ли оперативная память важную роль при выборе процессора?

Да, имеет значение не только количество (слишком малое может привести к, так называемым, заиканиям и зависаниям), но и достаточно быстрая оперативная память (ОЗУ) с относительно низкой задержкой. Это влияет на производительность процессора. Вы почувствуете разницу в играх, использующих мощность процессора, и в разрешениях до 1080p. На более высоких уровнях различия в производительности могут быть незначительными.

Учтите, что самая быстрая память – не всегда лучший выбор. Часто превышение некоторого предела не даёт таких значительных результатов и не стоит доплачивать за память, например, выше 3600 МГц. Для современных процессоров обычно достаточно оперативной памяти DDR4 в двухканальном режиме, работающей на частоте 3200 МГц и задержках CL 14-16. Память ниже 3000 МГц может ограничивать производительность.

Адекватная высокоскоростная оперативная память может уменьшить узкие места в играх, где производительность процессора имеет наибольшее значение. Особенно чёткие различия могут проявляться между ОЗУ в двухканальном режиме и одноканальной.

Как проверить, ограничивает ли процессор видеокарту

Самый простой способ – поставить на компьютер новую видеокарту. Если прирост частоты кадров в играх после её замены небольшой или даже нулевой, то вывод очевиден. Процессор, вероятно, слишком слаб для использования этого графического процессора. Такая замена окажется пустой тратой денег. Однако мы знаем, что не все могут себе это позволить, поэтому мы предложим несколько способов, которые помогут вам распознать узкое место.

Во-первых, давайте объясним, что такое процессорные и графические пространства, потому что они имеют решающее значение для определения того, какой компонент является узким местом в компьютере.

Что такое процессорное пространство? Это то, которое, в основном, использует мощность ЦП, например, большой город, заполненный неигровыми персонажами, такими как Новиград и Боклер из The Witcher 3: Wild Hunt и расширения Blood and Wine, или поле битвы из стратегической серии Total War. В таких местах сцена динамично меняется, потому что игрок может видеть, например, персонажей, находящихся на экране в движении.

Графическое пространство, как вы можете догадаться, основано на производительности видеокарты, в том числе наложении текстур и подсчёте теней, заполняющих заданную сцену, отрисовка разветвленной геометрической сетки (процессор занимается начальной обработкой) и обработка каждого пикселя. Такое место часто называют статичным, где относительно мало что происходит, но есть чем полюбоваться. Примером такого места может быть – если оставаться в «Ведьмаке 3» – лес возле деревни Ферлунд на Скеллиге.

Поможет ли MSI Afterburner распознать узкое место

Бесплатное приложение, такое как MSI Afterburner с подключенным сервером статистики RivaTuner (RTSS), может помочь в выявлении узких мест. Он позволяет следить за работой процессора или видеокарты в игре.

Что скажет нам степень загрузки компонентов, когда мы достигнем места, где GPU будет загружен только на 50-60%, а из процессора будет выжата последняя капля пота (индикатор будет постоянно сообщать о почти максимальной загрузке)? Например, мы нашли типичное процессорное пространство: проверьте, нет ли резкого падения потока анимации в этих местах – если это так, то да, ЦП может быть причиной проблем с производительностью.

Часто ситуация не столь очевидна. Другой пример: в пространстве ЦП конкретной игры загрузка ЦП составляет 60%, а видеокарта загружена на 97%. На первый взгляд кажется, что вообще нет никаких проблем. Но, всё не так просто. В описанном сценарии CPU также ограничивает производительность GPU, хотя индикаторы нам об этом не говорят. Вы даже можете неправильно их прочитать и подумать, что видеокарта ограничивает производительность, потому что она работает на полной скорости, а плавность оставляет желать лучшего.

Ошибочно основывать свои выводы исключительно на степени загруженности CPU и GPU! Вы не должны смотреть на них без размышлений, потому что они могут не иметь никакой ценности сами по себе. В лучшем случае, они могут облегчить обнаружение компонента, являющегося узким местом.

Не забывайте, это может быть и оперативная память. Многие пользователи часто комбинируют современный процессорный блок с памятью на 2133 или 2666 МГц, что является ужасной идеей. Как мы уже упоминали, замена оперативной памяти на 3200-3600 МГц может вдохнуть новую жизнь в процессор, который будет лучше работать в местах, требующих большой мощности.

Поможет ли изменение разрешения и настроек обнаружить узкое место?

Стоит сочетать вышеописанный метод с другими, что повысит вероятность обнаружения узкого места. Важность процессора возрастает по мере снижения разрешения и/или конкретных деталей. Если вы уменьшите их, и это не даст желаемого прироста производительности, это может быть признаком узкого места.

Может быть, а может и нет. Многое зависит от движка и оптимизации игры – существует много игр, в которых изменение настроек графики не даёт слишком большого прироста FPS.

Кроме того, существует множество графических настроек, зависящих от видеокарты, поэтому этот метод не будет эффективным. Лучшим решением было бы протестировать разные процессоры, например, со средней детализацией на сильной видеокарте, чтобы увидеть, были ли и какие изменения в производительности. Но опять же – вряд ли у кого есть такая возможность. Поэтому проверьте эффекты после изменения разрешения. Например, если вы получаете (почти) такое же количество кадров в секунду в 1080p, как и в 1440p, проблема заключается в процессоре.

Интересно, что может также оказаться, что даже когда мы тестируем игру в обычном графическом пространстве, процессор может стать ограничением производительности. Даже в более высоких разрешениях, 1440p и 4K, нужен подходящий CPU, что особенно видно на сочетании Intel Core i3 и топового GPU. В современных играх четырёх ядер (включая HT/SMT) во многих случаях недостаточно для сильных видеокарт, причём не последних поколений.

Если вы всё ещё сомневаетесь, стоит поискать надёжные тесты производительности как процессоров, так и видеокарт, и спросить у экспертов или людей, более знакомых с темой, например, на форумах, сайтах и в социальных группах. Лучше всего ознакомиться с мнениями разных пользователей – никогда не полагайтесь только на одно, которое может ввести вас в заблуждение. Вы ничего от этого не потеряете, а сможете лишь получить дополнительные знания, которые всегда стоит проверить (или хотя бы попробовать).

Как определить, что комбинация процессора и видеокарты работает плохо

Когда вы, как геймер, заметите аномалию в виде очень разных показателей производительности в разных местах игры, вы, несомненно, начнёте задаваться вопросом: в чём же дело? Когда вы заметите, что большую часть игры игра работает плавно, но в городе, полном NPC производительность резко падает, GPU не будет виноват. Замена этого компонента ничего не даст, потому что его возможности будут ограничены процессором.

Когда игровой процесс вас не удовлетворяет, независимо от того, где вы находитесь, ваша видеокарта должна привлечь ваше внимание. Её замена может поднять FPS. Если этот компонент вызывает затруднения, вы можете сначала понизить детализацию и посмотреть, даст ли это желаемый эффект.

Однако может оказаться, что для данной игры и процессор, и видеокарта не соответствуют аппаратным требованиям, и тогда придётся заменить оба компонента. Покупка более мощного графического процессора может решить проблему лишь частично, но тогда его производительность будет ограничена устаревшими и слишком медленным процессором.

Всегда ли процессор должен идеально подходить к видеокарте

Процессор обычно заменяют не так часто, как видеокарту. Всегда ли нужно идеально сочетать процессор с графическим процессором? Стоит ли задуматься о будущей покупке процессора и какую пользу может принести такой выбор?

Идеальный тандем CPU и GPU – это тот, который подойдёт именно вам

Что это значит? Вы уже знаете, что выбор процессора для видеокарты должен быть продиктован тем, во что и как вы играете. В зависимости от этого инвестируйте больше в процессор или видеокарту. В противном случае распределите свой бюджет на CPU и GPU. Если играете в стратегии, особенно во франшизу Total War, купите более мощный процессор и более слабую видеокарту. Для этого компоненты не должны идеально сочетаться, но и не впадайте в крайности.

Другое дело, когда вы играете в игры, требующие мощного графического процессора. Тогда потратьте немного больше денег на видеокарту, но, как мы упоминали ранее, в меру. Не совмещайте, например, Intel Core i3 с (почти) топовыми GeForce или Radeon.

Когда вы играете в высоком разрешении, переход на ЦП нового поколения может не привести к скачку игровой производительности. Например, владелец Ryzen 5 3600X может не получить никаких преимуществ в разрешении 4K при переходе на Ryzen 5 5600X. Потратьте немного больше на GPU. Новые процессоры, в свою очередь, принесут улучшения производительности с хорошим графическим процессором в разрешении 1080p.

Помните, что ваши потребности также важны, а не только общая производительность компонентов.

Есть ли смысл думать о покупке процессора?

Почему вы должны сесть и подумать о том, что вас ждёт впереди, прежде чем выбрать процессор? Учитывая, что сердцем консолей текущего поколения (PlayStation 5, Xbox Series X и Xbox Series S) является 8-ядерный и 16-поточный процессор, стоит рассмотреть такой же ЦП для компьютера.

Даже если купленный процессор не будет иметь столько эффективных ядер, как его преемники, достаточное их количество может окупиться в будущих играх. Поэтому современные игры могут работать лучше. Может оказаться, что слишком малое количество ядер (потоков) позже будет ограничивать производительность, как это было в прошлом, например, в Assassin’s Creed: Origins, The Division 2 или Battlefield V.

Пример процессора AMD Ryzen 5 1600X доказывает, что иногда стоит инвестировать с мыслью о будущем. Вышеупомянутая модель благодаря 6-ядерной и 12-поточной конфигурации достойно послужила в отличие от конкурирующего Intel Core i5-7600K аналогичного периода. Почему? Потому что сопоставимый в то время блок Intel имел только 4 ядра и 4 потока, чего уже недостаточно в современных играх, использующих больше ядер.

В играх, которые больше ориентированы на одно ядро, Intel Core i5-7600K часто лучше. В более новых, полных многоядерных играх, Ryzen 5 1600X может выделиться на фоне своего соперника.

Эта «красная» модель процессора оказалась настолько удачной, что AMD даже решила обновить её как Ryzen 5 1600 AF, в которой используется улучшенная архитектура (Zen+) и более низкий техпроцесс (12 нм вместо 14 нм). Благодаря этому он вплотную приблизился по производительности к конкурирующему Intel Core i5-9400F (значительно более новому, чем Core i5-7600K).

То же самое может произойти и через несколько лет, когда на рынок начнут поступать игры, созданные исключительно для консолей PS5 и Xbox Series X/S. Для этих игр конфигурация 6/12 уже может выглядеть бледно на фоне 8/16.

Всё это ближе к гаданию на кофейной гуще, хотя такое мышление имеет под собой прочную основу.

Более мощный процессор также открывает путь к покупке более производительной видеокарты. Иногда можно вложить больше, но с умом – чтобы не переусердствовать в ту или иную сторону. Почему? Прогресс в следующих поколениях трудно предсказать, поэтому это не может быть хорошим решением. Конкретно сейчас всё проще, ведь мы после премьеры новых консолей, так что покупка, например, Ryzen 7 5800X может окупиться, особенно если вы не собираетесь его заменять в ближайшие годы.

А может будущая покупка процессора не имеет смысла?

Какова обратная сторона медали, когда дело доходит до покупки процессора на будущее? К сожалению, есть риск, что через несколько лет мощности ЦП может не хватить для игр, даже если мы думаем, что купили ЦП надолго. Большое количество ядер может замедлить его старение, но позже может быть трудно скрыть любые недостатки, которые проявятся с течением времени.

С ядрами тоже может быть не всё так радужно. Sony и Microsoft хотят поддерживать старые консоли в течение многих лет. Могут пройти столетия, прежде чем появится достаточно игр, чтобы в полной мере использовать преимущества 8-ядерных и 16-поточных процессоров. Понимаешь, куда мы идём? Выбор такого процессора может быть менее оправданным, потому что он слишком уродливо устареет, прежде чем действительно раскроет себя в играх.

Это сложнее, чем кажется, так как зависит от ряда факторов: как игры будут использовать ядра, какой прогресс в архитектуре ЦП и сколько тайтлов выиграют от новинки. Прирост производительности в последние годы был не таким большим, как в случае с видеокартами, поэтому риск того, что процессор текущего поколения окажется слишком слабым звеном после премьеры следующего, ниже, чем в первое десятилетие 21 века.

Подводя итог, стоит добавить, что если вы планируете перейти на монитор с более высоким разрешением, то чрезмерные вложения в процессор не имеют особого смысла. Ведь вы знаете, что по мере роста разрешения важность этого компонента снижается, а основной акцент смещается на видеокарту. Есть шанс, что процессора, который не оправдывает ожиданий в 1080p, будет достаточно для геймплея 4K.

Какие могут быть последствия плохого согласования CPU и GPU

Неправильный выбор процессора для видеокарты может иметь фатальные последствия. Например, если совместить Intel Celeron или Pentium с GeForce RTX 3080, то в играх такой набор может оказаться существенно хуже, чем связка процессора Intel Core i9-11900K и RTX 3060.

Чем хуже вы выберете эти компоненты, тем менее комфортной будет игра. Так как CPU может ограничивать производительность GPU даже в типично графических пространствах, не стоит выбирать процессор с самой нижней полки для видеокарты с самой высокой (это, конечно, крайний пример для лучшей наглядности).

Однако, как мы уже упоминали, компоненты не обязательно должны быть идеально подобраны, всё зависит от многих факторов. Если вы покупаете мощную видеокарту, но ваш нынешний процессор лишь немного её ограничивает, то ничего страшного не произойдет. Если вы получаете 165 вместо 180 кадров в секунду, это, вероятно, не будет иметь большого значения, верно?

Кроме того, когда вы впоследствии поменяете процессор, проблема исчезнет. Из двух плохих моментов лучше иметь слишком мощный для видеокарты процессор, чем наоборот. За исключением случаев, когда различия относительно малы или даже незаметны.

Также может случиться так, что даже если процессор является проблемой в игре, она будет проявляться только в отдельных локациях, например, в большом городе, полном NPC, а в других случаях, в зависимости от мощности графического процессора, игра будет работать без особых потертостей.

Вы должны ответить на вопрос: представляет ли этот сценарий для вас проблему, которую необходимо решить?

Лучшее сочетание процессора и видеокарты

Рецепт прост. Попробуйте выбрать процессор низкого класса для малобюджетной видеокарты, средний процессор для среднего графического процессора и т.д. Вам не обязательно придерживаться этих ограничений. В конце концов, если вы играете в игры, которые больше зависят от видеокарты, выберите чуть более мощный чип, даже с немного более слабым процессором. Тогда такое сочетание будет наиболее оправдано.

Ключевым моментом является выбор сбалансированных компонентов, чтобы производительность одного из них существенно не отличалась от другого. Видеокарта не отвечает за количество кадров в секунду – в зависимости от игры или сценария процессор (и, в меньшей степени, оперативная память) также оказывает большее или меньшее влияние на значение кадров в секунду. Мы надеемся, что наше руководство поможет вам выбрать правильные компоненты.

Прежде чем принять решение о покупке процессора для конкретной видеокарты, ознакомьтесь с характеристиками и тестами производительности для игр. Это определенно облегчит вам выбор и сопоставление процессора с видеокартой.

Вычисления на GPU – зачем, когда и как. Плюс немного тестов

Всем давно известно, что на видеокартах можно не только в игрушки играть, но и выполнять вещи, никак не связанные с играми, например, нейронную сеть обучить, криптовалюту помайнить или же научные расчеты выполнить. Как так получилось, можно прочитать тут, а я хотел затронуть тему того, почему GPU может быть вообще интересен рядовому программисту (не связанному с GameDev), как подступиться к разработке на GPU, не тратя на это много времени, принять решение, нужно ли вообще в эту сторону смотреть, и «прикинуть на пальцах», какой профит можно получить.

Статья написана по мотивам моего выступления на HighLoad++. В ней рассматриваются в основном технологии, предлагаемые компанией NVIDIA. У меня нет цели рекламировать какие-либо продукты, я лишь привожу их в качестве примера, и наверняка что-то похожее можно найти у конкурирующих производителей.

Зачем что-то считать на GPU?

Два процессора можно сравнить по разным критериям, наверное, самые популярные — это частота и количество ядер, размер кэшей и прочее, но в конечном счете, нас интересует, сколько операций процессор может выполнить за единицу времени, что это за операции вопрос отдельный, но наиболее распространенной метрикой является количество операций с плавающей запятой в секунду — flops. И когда мы хотим сравнить теплое с мягким, а в нашем случае GPU с CPU, эта метрика приходится как нельзя кстати.

Ниже на графике изображены рост этих самых флопсов с течением времени для процессоров и для видеокарт.

(Данные собраны из открытых источников, нет данных за 2019-20 годы, т.к. там не все так красиво, но GPU все-таки выигрывают)

Что ж, заманчиво, не правда ли? Перекладываем все вычисления с CPU на GPU и получаем в восемь раз лучшую производительность!

Но, конечно же, не все так просто. Нельзя просто так взять и переложить все на GPU, о том почему, мы поговорим дальше.

Архитектура GPU и ее сравнение с CPU

Привожу многим знакомую картинку с архитектурой CPU и основными элементами:

Что здесь особенного? Одно ядро и куча вспомогательных блоков.

А теперь давайте посмотрим на архитектуру GPU:

У видеокарты множество вычислительных ядер, обычно несколько тысяч, но они объединены в блоки, для видеокарт NVIDIA обычно по 32, и имеют общие элементы, в т.ч. и регистры. Архитектура ядра GPU и логических элементов существенно проще, чем на CPU, а именно, нет префетчеров, бранч-предикторов и много чего еще.

Что же, это ключевые моменты отличия в архитектуре CPU и GPU, и, собственно, они и накладывают ограничения или, наоборот, открывают возможности к тому, что мы можем эффективно считать на GPU.

Я не упомянул еще один важный момент, обычно, видеокарта и процессор не «шарят» память между собой и записать данные на видеокарту и считать результат обратно — это отдельные операции и могут оказаться «бутылочным горлышком» в вашей системе, график зависимости времени перекачки от размера данных приведен далее в статье.

Ограничения и возможности при работе с GPU

Какие ограничения накладывает такая архитектура на выполняемые алгоритмы:

- Если мы выполняем расчет на GPU, то не можем выделить только одно ядро, выделен будет целый блок ядер (32 для NVIDIA).

- Все ядра выполняют одни и те же инструкции, но с разными данными (поговорим про это дальше), такие вычисления называются Single-Instruction-Multiple-Data или SIMD (хотя NVIDIA вводит свое уточнение).

- Из-за относительно простого набора логических блоков и общих регистров, GPU очень не любит ветвлений, да и в целом сложной логики в алгоритмах.

- Собственно, ускорение тех самых SIMD-вычислений. Простейшим примером может служить поэлементное сложение матриц, его и давайте разберем.

Приведение классических алгоритмов к SIMD-представлению

Трансформация

У нас есть два массива, A и B, и мы хотим к каждому элементу массива A добавить элемент из массива B. Ниже приведен пример на C, хотя, надеюсь, он будет понятен и тем, кто не владеет этим языком:

Классический обход элементов в цикле и линейное время выполнения.

А теперь посмотрим, как такой код будет выглядеть для GPU:

А вот здесь уже интересно, появилась переменная threadIdx, которую мы вроде бы нигде не объявляли. Да, нам предоставляет ее система. Представьте, что в предыдущем примере массив состоит из трех элементов, и вы хотите его запустить в трех параллельных потоках. Для этого вам бы понадобилось добавить еще один параметр – индекс или номер потока. Вот это и делает за нас видеокарта, правда она передает индекс как статическую переменную и может работать сразу с несколькими измерениями – x, y, z.

Еще один нюанс, если вы собираетесь запускать сразу большое количество параллельных потоков, то потоки придется разбить на блоки (архитектурная особенность видеокарт). Максимальный размер блока зависит от видеокарты, а индекс элемента, для которого выполняем вычисления, нужно будет получать так:

В итоге что мы имеем: множество параллельно работающих потоков, выполняющих один и тот же код, но с разными индексами, а соответственно, и данными, т.е. тот самый SIMD.

Это простейший пример, но, если вы хотите работать с GPU, вашу задачу нужно привести к такому же виду. К сожалению, это не всегда возможно и в некоторых случаях может стать темой докторской диссертации, но тем не менее классические алгоритмы все же можно привести к такому виду.

Агрегация

Давайте теперь посмотрим, как будет выглядеть агрегация, приведенная к SIMD представлению:

У нас есть массив из n элементов. На первом этапе мы запускаем n/2 потоков и каждый поток складывает по два элемента, т.е. за одну итерацию мы складываем между собой половину элементов в массиве. А дальше в цикле повторяем все тоже самое для вновь получившегося массива, пока не сагрегируем два последних элемента. Как видите, чем меньше размер массива, тем меньше параллельных потоков мы можем запустить, т.е. на GPU имеет смысл агрегировать массивы достаточно большого размера. Такой алгоритм можно применять для вычисления суммы элементов (кстати, не забывайте о возможном переполнении типа данных, с которым вы работаете), поиска максимума, минимума или просто поиска.

Сортировка

А вот с сортировкой уже все выглядит намного сложнее.

Два наиболее популярных алгоритма сортировки на GPU это:

- Bitonic-sort

- Radix-sort

Но идея в том, что даже такой нелинейный алгоритм, как сортировка, можно привести к SIMD-виду.

А теперь, прежде чем посмотреть на реальные цифры, которые можно получить от GPU, давайте разберемся, как же все-таки программировать под это чудо техники?

C чего начать

Наиболее распространены две технологии, которые можно использовать для программирования под GPU:

- OpenCL

- CUDA

Использовать OpenCL можно из C/C++, есть биндинги к другим языкам.

По OpenCL мне больше всего понравилась книга «OpenCL in Action». В ней же описаны разные алгоритмы на GPU, в т.ч. Bitonic-sort и Radix-sort.

CUDA – это проприетарная технология и SDK от компании NVIDIA. Писать можно на C/C++ или использовать биндинги к другим языкам.

Сравнивать OpenCL и CUDA несколько не корректно, т.к. одно — стандарт, второе — целое SDK. Тем не менее многие выбирают CUDA для разработки под видеокарты несмотря на то, что технология проприетарная, хоть и бесплатная и работает только на картах NVIDIA. Тому есть несколько причин:

- Более продвинутое API

- Проще синтаксис и инициализация карты

- Подпрограмма, выполняемая на GPU, является частью исходных текстов основной (host) программы

- Собственный профайлер, в т.ч. и визуальный

- Большое количество готовых библиотек

- Более живое комьюнити

Наиболее полноценной книгой по CUDA, на которую я наткнулся, была «Professional CUDA C Programming», хоть уже и немного устарела, тем не менее в ней рассматривается много технических нюансов программирования для карт NVIDIA.

А что, если я не хочу тратить пару месяцев на чтение этих книг, написание собственной программы для видеокарты тестирование и отладку, а потом выяснить, что это все не для меня?

Как я уже сказал, есть большое количество библиотек, которые скрывают сложности разработки под GPU: XGBoost, cuBLAS, TensorFlow, PyTorch и другие, мы рассмотрим библиотеку thrust, так как она менее специализирована, чем другие вышеприведенные библиотеки, но при этом в ней реализованы базовые алгоритмы, например, сортировка, поиск, агрегация, и с большой вероятностью она может быть применима в ваших задачах.

Thrust – это С++ библиотека, которая ставит своей целью «подменить» стандартные STL алгоритмы на алгоритмы выполняемые на GPU. Например, сортировка массива чисел с помощью этой библиотеки на видеокарте будет выглядеть так:

(не забываем, что пример нужно компилировать компилятором от NVIDIA)

Как видите, thrust::sort очень похож на аналогичный алгоритм из STL. Эта библиотека скрывает много сложностей, в особенности разработку подпрограммы (точнее ядра), которая будет выполняться на видеокарте, но при этом лишает гибкости. Например, если мы хотим отсортировать несколько гигабайт данных, логично было бы отправить кусок данных на карту запустить сортировку, и пока выполняется сортировка, дослать еще данные на карту. Такой подход называется latency hiding и позволяет более эффективно использовать ресурсы серверной карты, но, к сожалению, когда мы используем высокоуровневые библиотеки, такие возможности остаются скрытыми. Но для прототипирования и замера производительности как раз таки подходят, в особенности с thrust можно замерить, какой оверхед дает пересылка данных.

Я написал небольшой бенчмарк с использованием этой библиотеки, который выполняет несколько популярных алгоритмов с разным объемом данных на GPU, давайте посмотрим, какие результаты получились.

Результаты выполнения алгоритмов на GPU

Для тестирования GPU я взял инстанс в AWS с видеокартой Tesla k80, это далеко не самая мощная серверная карта на сегодняшний день (самая мощная Tesla v100), но наиболее доступная и имеет на борту:

- 4992 CUDA ядра

- 24 GB памяти

- 480 Gb/s — пропускная способность памяти

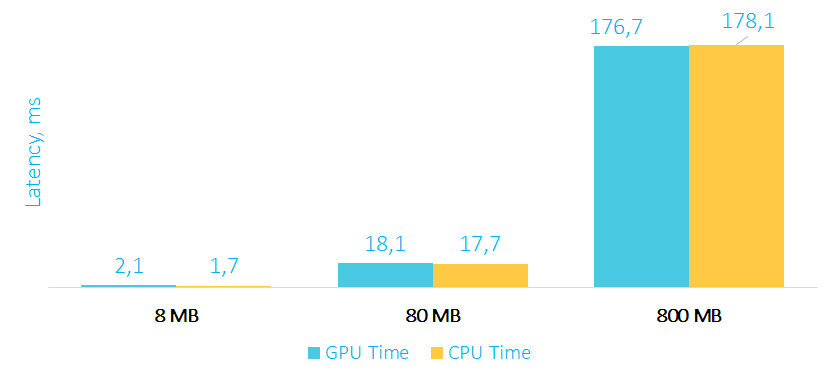

Трансформация

Время выполнения трансформации на GPU и CPU в мс

Как видите, обычная трансформация элементов массива выполняется по времени примерно одинаково, как на GPU, так и на CPU. А все почему? Потому что оверхед на пересылку данных на карту и обратно съедает весь performance boost (про оверхед мы поговорим отдельно), да и вычислений на карте выполняется относительно немного. К тому же не стоит забывать, что процессоры также поддерживают SIMD инструкции, и компиляторы в простых случаях могут эффективно их задействовать.

Давайте теперь посмотрим, насколько эффективно выполняется агрегация на GPU.

Агрегация

Время выполнения агрегации на GPU и CPU в мс

В примере с агрегацией мы уже видим существенный прирост производительности с увеличением объема данных. Стоит также обратить внимание на то, что в память карты мы перекачиваем большой объем данных, а назад забираем только одно агрегированное значение, т.е. оверхед на пересылку данных из карты в RAM минимален.

Перейдем к самому интересному примеру – сортировке.

Сортировка

Время выполнения сортировки на GPU и CPU в мс

Несмотря на то, что мы пересылаем на видеокарту и обратно весь массив данных, сортировка на GPU 800 MB данных выполняется примерно в 25 раз быстрее, чем на процессоре.

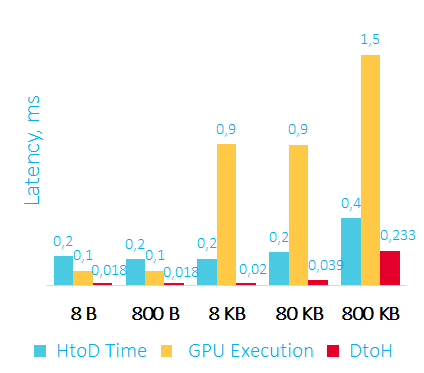

Оверхед на пересылку данных

Как видно из примера с трансформацией, не всегда очевидно, будет ли GPU эффективен даже в тех задачах, которые хорошо параллелятся. Причиной тому — оверхед на пересылку данных из оперативной памяти компьютера в память видеокарты (в игровых консолях, кстати, память расшарена между CPU и GPU, и нет необходимости пересылать данные). Одна из характеристик видеокарты это — memory bandwidth или пропускная способность памяти, которая определяет теоретическую пропускную способность карты. Для Tesla k80 это 480 GB/s, для Tesla v100 это уже 900 GB/s. Также на пропускную способность будет влиять версия PCI Express и имплементация того, как вы будете передавать данные на карту, например, это можно делать в несколько параллельных потоков.

Давайте посмотрим на практические результаты, которые удалось получить для видеокарты Tesla k80 в облаке Amazon:

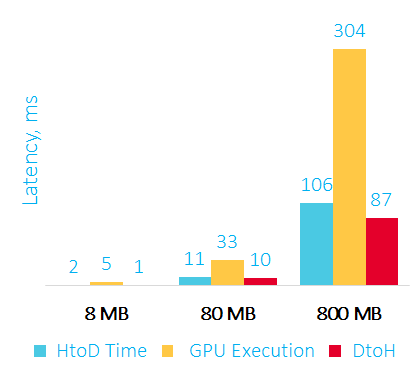

Время пересылки данных на GPU, сортировки и пересылки данных обратно в RAM в мс

HtoD – передаем данные на видеокарту

GPU Execution – сортировка на видеокарте

DtoH – копирование данных из видеокарты в оперативную память

Первое, что можно отметить – считывать данные из видеокарты получается быстрее, чем записывать их туда.

Второе – при работе с видеокартой можно получить latency от 350 микросекунд, а этого уже может хватить для некоторых low latency приложений.

Ниже на графике приведен оверхед для большего объема данных:

Время пересылки данных на GPU, сортировки и пересылки данных обратно в RAM в мс

Серверное использование

Наиболее частый вопрос — чем отличается игровая видеокарта от серверной? По характеристикам они очень похожи, а цены отличаются в разы.

Основные отличия серверной (NVIDIA) и игровой карты:

- (игровая карта не рассчитана на серверное использование)

- Возможные проблемы с виртуализацией для потребительской видеокарты

- Наличие механизма коррекции ошибок на серверной карте

- Количество параллельных потоков (не CUDA ядер) или поддержка Hyper-Q, которая позволяет из нескольких потоков на CPU работать с картой, например, из одного потока закачивать данные на карту, а из другого запускать вычисления

Многопоточность

После того как мы разобрались, как запустить простейший алгоритм на видеокарте и каких результатов можно ожидать, следующий логичный вопрос, а как будет себя вести видеокарта при обработке нескольких параллельных запросов. В качестве ответа у меня есть два графика выполнения вычислений на GPU и процессоре с 4-мя и 32-мя ядрами:

Время выполнения математических расчетов на GPU и CPU c матрицами размером 1000 x 60 в мс

На этом графике выполняются расчеты с матрицами размером 1000 x 60 элементов. Запускаются вычисления из нескольких программных потоков, для GPU дополнительно создается отдельный stream для каждого CPU-потока (используется тот самый Hyper-Q).

Как видно, процессор справляется с такой нагрузкой очень хорошо, при этом latency для одного запроса на GPU существенно растет с увеличением числа параллельных запросов.

Время выполнения математических расчетов на GPU и CPU c матрицами 10 000 x 60 в мс

На втором графике те же самые вычисления, но с матрицами в 10 раз больше, и GPU под такой нагрузкой ведет себя существенно лучше. Эти графики очень показательны, и можно сделать вывод: поведение под нагрузкой зависит от характера самой нагрузки. Процессор может также довольно эффективно справляться с матричными вычислениями, но до определенных пределов. Для видеокарты характерно то, что для небольшой вычислительной нагрузки производительность падает примерно линейно. С увеличением нагрузки и количества параллельных потоков видеокарта справляется уже лучше.

Сложно строить гипотезы, как будет себя вести GPU в различных ситуациях, но, как видите, при определенных условиях серверная карта может достаточно эффективно обрабатывать запросы из нескольких параллельных потоков.

Обсудим еще несколько вопросов, которые могут возникнуть у вас, если вы все-таки решили использовать GPU в своих проектах.

Ограничение ресурсов

Как мы уже говорили, два основных ресурса видеокарты – это вычислительные ядра и память.

К примеру, у нас несколько процессов или контейнеров, использующих видеокарту, и хотелось бы иметь возможность поделить видеокарту между ними. К сожалению, простого API для этого нет. NVIDIA предлагает технологию vGPU, но карту Tesla k80 я не нашел в списке поддерживаемых, и насколько мне удалось понять из описания, технология больше заточена на виртуальные дисплеи, чем на вычисления. Возможно, AMD предлагает что-то более подходящее.

Поэтому, если планируете использовать GPU в своих проектах, стоит рассчитывать на то, что приложение будет использовать видеокарту монопольно, либо вы будете программно контролировать объем выделяемой памяти и количество ядер, используемых для вычислений.

Контейнеры и GPU

Если с ограничением ресурсов вы разобрались, то следующий логичный вопрос: а если в сервере несколько видеокарт?

Опять же, можно на уровне приложения решать, какой GPU оно будет использовать.

Другой более удобный способ – это Docker-контейнеры. Можно использовать и обычные контейнеры, но NVIDIA предлагает свои контейнеры NGC, с оптимизированными версиями различного софта, библиотек и драйверов. Для одного контейнера можно ограничить количество используемых GPU и их видимость для контейнера. Оверхед на использования контейнера около 3%.

Работа в кластере

Другой вопрос, что делать, если вы хотите выполнять одну задачу на нескольких GPU в рамках одного сервера или кластера?

Если вы выбрали библиотеку на подобии thrust или более низкоуровневое решение, то задачу придется решать вручную. Высокоуровневые фреймворки, например, для машинного обучения или нейронных сетей, обычно поддерживают возможность использования нескольких карт из коробки.

Дополнительно хотелось бы отметить то, что, например, NVIDIA предлагает интерфейс прямого обмена данными между картами – NVLINK, который существенно быстрее чем PCI Express. И есть технология прямого доступа к памяти карты из других PCI Express устройств – GPUDirect RDMA, в т.ч. и сетевых.

Рекомендации

Если вы размышляете об использовании GPU в своих проектах, то GPU, скорее всего, вам подойдет если:

Как проверить совместимость процессора и видеокарты?

Совместимость компонентов – это основополагающий фактор любого апгрейда компьютера. Особенно остро встает вопрос на совместимость процессора и видеокарты для геймеров. В данном материале вы узнаете, какие роли возложены на CPU и GPU, как проверить совместимость процессора и видеокарты, чтобы отыскать наилучший баланс между ними опираясь на статистику бенчмарков и приобретенные знания.

Совместимость процессора и видеокарты – базовая информация

Для проверки совместимости в дебри работы компонентов лезть не нужно. Важно понимать логику работу отдельных компонентов и всей системы в целом. Кто за что отвечает:

- Центральный процессор (CPU) – отвечает за физику и геометрию. ЦП создает всю ту картинку, которую в последствии отрисовывает видеокарта.

- Видеокарта (GPU) – отвечает за отрисовку картинки (сетка, ланшафт) и все красоты, воспринимающиеся нашими глазами.

- Материнская карта – связующее звено всех элементов компьютера, в том числе CPU и GPU. Чтобы оба компонента успешно могли сосуществовать в одном компьютере, их разъемы должны поддерживаться материнкой. Например, одинаковая версия сокета для процессора и одинаковая (желательно) системной шины PCI Express для дискретной видеокарты.

Вернемся к совместимости процессора и видеокарты. Когда ЦП не успевает отрендерить нужное количество кадров (FPS), которые нужны графической карточке, начинается ботлнекинг (bottleneck). То есть один из компонентов системы не дает другому (или другим) компонентам раскрыть весь свой потенциал. Узкое горлышко (перевод bottleneck) демонстрирует показательный пример этому явлению.

При ботлнекинге ЦП загрузка видеокарты может постоянно манятся от 0 до 100%, может не доходить до 100%. Такие поведенческие факторы говорят о том, что процессор не успевает за графической картой.

Или наоборот – процессор довольно мощный, а видеокарта не успевает ним. Это заметить сложнее, потому как явных фризов не будет, а будет попросту низкий FPS. Чтобы как-то стабилизировать ситуацию, следует понижать настройки игры.

Избавит от такого явления проверка совместимости процессора и видеокарты.

Проверка совместимости процессора и видеокарты

Есть три способа подбора видеокарты под процессор:

- Просмотр характеристик и соответствие между компонентами. Это нужно для того, чтобы выявить, смогут ли вообще сосуществовать CPU и GPU в единой системе.

- Проверка процессора и видеокарты через прогнанный бенчмарк. Сравнение голых цифр чтобы выявить «зеленую зону» для наилучшего баланса.

- Собственный опыт определения в тех играх, которые вы запускаете.

По характеристикам

Современные дискретные карты графики подключаются к материнской плате через слот PCIe версии 3.0. При этом поддержка PCIe должна быть не только у материнской платы, но и у ЦП, иначе могут наблюдаться проблемы стандартного функционирования всего ПК.

В 2019 году ознаменовалась эра поддержки версии PCIe 4.0 с выходом материнских плат X570 Aorus от Gigabite. Теперь на рынке 2020 года можно найти все компоненты (материнка, ЦП, дискретная карта) с поддержкой новой версии слота, с лучшей пропускной способностью. Но цены – кусаются.

Если же видеокарта совместно с материнкой поддерживает PCIe 4.0, а процессор только PCIe 3.0 – вся система будет работать с PCIe 3.0. То есть возвращается к тебе ботлнекинга.

В целом сейчас материнские платы создаются под различные модели и различные производители, поэтому ошибиться в дефолтных характеристиках не получится:

1. За совместимость материнки и CPU отвечает сокет. Популярными являются Socket 1050, 1151, 2011, 2066, AM3+, AM4, FM2+.

2. За совместимость GPU отвечает слот PCIe x.

Этой совместимости достаточно для запуска системы.

Совместимость процессора и видеокарты – тесты бенчмарка

Если вы прицениваетесь или у вас на руках уже есть ЦП и дискретная карта, повести проверку на «идеальную пару» поможет PassMark Software. Пользоваться им довольно легко. Исходные данные можно найти в таблице:

- Для видеокарт – https://www.videocardbenchmark.net/gpu_list.php

- Для процессоров – https://www.cpubenchmark.net/cpu_list.php

Инструкция использования такая:

1. В поисковую строку первой таблицы введите модель графической карты (например GTX 1070).

2. В поисковую строку второй таблицы введите модель процессора (например Intel Core i5 6600K).

3. Сравните оба показателя по рейтингу Passmark. Идеальный баланс достигается при показателях равных или отличающихся друг от друга не более чем на 10%.

4. В данном примере видно, что процессор Intel Core i5 6600K не дает раскрыть весь потенциал графической карты Geforce GTX

5. В зеленой зоне вместе с Geforce GTX 1070 будут ЦП Core i7 6900K, AMD Ryzen 5 2600, Core i9 9900T.

6. В зеленой зоне вместе с Intel Core i5 6600K будут GeForce GTX 1050 Ti, Radeon RX 570.

7. Вторым критерием будет цена. Сравнивайте их перед окончательным выбором.

Мониторинг процессора и видеокарты с помощью простой таблицы с цифрами показал несовместимость выбранных изначально комплектующих и помог подобрать более правильные пары, чем избавил от ботлнекинга.

Но правильно ли опираться на голые числа? Не совсем, если у тебя появляется кой какой опыт зависимости одних показателей от других. При этом, в играх или требовательных к ресурсам программах на плечи процессора могут ложится совсем незначительные задачи геометрии, а вот видеокарте приходится тяжко, чтобы нарисовать картинку, которая воспринимается зрительно очень и очень красочно.

При таких обстоятельствах лучше провести тестинг собственноручно.

Совместимость процессора и видеокарты – тестирование своими руками

Если у вас есть один элемент системы (например, ЦП), а вам нужно подобрать правильный второй компонент (например, GPU), следует запустить одну из требовательных игр ААА класса.

Проследить, на что способен процессор можно, снизив настройки в игре все, за которые отвечает видеокарта. Этим вы снимаете нагрузку с графического ядра, чтобы она не была загружена на 100%. После этого вы увидите, какое количество кадров готов отрисовать ваш процессор в той или иной игре. В каждой игре отрисовка будет своя. По большому счету это зависит от движка игры и тех технологий, что используются для нее.

После определения FPS при минимальных настройках графики нужно подбирать под нее видеокарту, которая также сможет обеспечить такой же уровень FPS в игре. Например, если в Ведьмак 3 ЦП покажет 30 FPS, то и видеокарту нужно подбирать 30 FPS. Если же GPU может разогнаться до 60 кадров, процессор просто не сможет успевать за ним и проявится ботлнекинг.

На примере двух игр опытным путем выясните соответствует ли процессор и видеокарта в играх одинаковому фреймрейту.

Для Battlefield One:

1. Зайдите в Настройки графики и снизьте их. За графику отвечает – разрешение экрана, качество графики, трава, постообработка, эффекты. За физику и геометрию в ЦП – ландшафт и сетка.

2. Практически убрав всю графику, был поднят до неплохих показателей кадров 115-150 FPS.

3. Поэтому для процессора Intel Core i5 6600K в данной игре вполне неплохо зайдет Geforce GTX.

Для Ведьмака 3:

1. Зайдите в настройки графики и выставите низкие показатели графики (HD разрешение и постобработка).

2. За число персонажей на экране и качество рельефа отвечает процессор, поэтому данные показатели оставляйте на максимуме.

3. В Новиграде при множестве NPC тоже показывает довольно большой фреймрейт.

4. При таком показателе тоже можно сделать вывод, что ЦП будет отлично смотреться в паре с GeForce GTX.

Количество выдаваемых FPS тех или иных видеокарт можно посмотреть в бенчмарках по популярных играх. Например, в зарубежном сервисе gpucheck.com.

Совместимость процессора и видеокарты – дополнительная информация

Важно помнить, что CPU и GPU под нагрузкой – это горячие печи, которые нужно должным образом охлаждать. Если это не выполняется, будет падать фреймрейт и должным образом не удастся выявить совместимость процессора и видеокарты.

Температуру CPU и GPU можно узнать с помощью программы AIDA64.

Во время простоя:

- температура ЦП должна быть в пределах 40 градусов;

- температура видеокарты 30-50 градусов.

Под нагрузкой показатель температуры:

- для ЦП равен 70-85 градусов;

- видеокарта 72-84 градуса.

Желательно придерживаться этих пределов, потому как превышение данного температурного режима приводит:

- к тротлингу;

- к лагам и фризам;

- к износу и преждевременному выводу из строя железа.

Определить совместимость процессора и видеокарты можно на уровне совместимости по железу, холодному расчету с помощью бенчмарков или собственной практики в точечно направленной игре или ресурсозависимой программе. Также, при проведении тестов не следует забывать об охлаждении и стараться всегда поддерживать оптимальную температуру в системном блоке ПК.

Pavel Ugryumov

Основатель и главный редактор компьютерного журнала PClegko. Маркетолог, предприниматель и и путешественник. Проект интернет-журнал PClegko — моё хобби. Но я планирую вырастить его в мировой проект. Каждая ваша оценка статьи и оставленный комментарий очень важны для меня. Если проект вам нравится, то буду рад если вы меня поддержите

Источник https://webznam.ru/blog/processora_pod_videokartu/2022-10-30-2176

Источник https://habr.com/ru/company/dbtc/blog/498374/

Источник https://pclegko.ru/komplektujushhie/sovmestimost-processora-i-videokarty.html